L’intelligence artificielle bouleverse notre perception de la beauté, créant de nouveaux standards parfois trompeurs et discriminatoires. Avatars peu diversifiés, filtres beauté irréalistes, diversité stéréotypée… autant de dérives qui interrogent.

Introduction

Après les réseaux sociaux et leur vie rêvée, l’IA générative va-t-elle, elle aussi, avoir un impact négatif sur notre image de soi et notre bien-être ? C’est ce que l’on peut craindre au regard de ce que l’intelligence artificielle propose visuellement à l’heure actuelle, car les biais y sont nombreux. L’intelligence artificielle (IA) révolutionne de nombreux aspects de notre vie, y compris la façon dont nous nous percevons et dont nous percevons les autres. Et pas forcément de manière positive.

En générant des avatars et des images qui circulent à travers les réseaux sociaux et les médias, l’IA influence non seulement comment nous nous voyons, mais aussi comment nous devrions apparaître aux yeux du monde. Entre avatars qui manquent de diversité ; standards de beauté stéréotypés ou encore filtres de beauté qui lissent toute imperfection et nous donnent bonne mine, certaines normes esthétiques se voient renforcer.

Vers une uniformisation stéréotypée ?

Les avatars, ces représentations numériques de nous-mêmes, sont de plus en plus présents dans nos vies, notamment sur les réseaux sociaux et dans les jeux vidéo. Cependant, les options proposées par les plateformes et applications manquent parfois de diversité. Les avatars sont souvent basés sur des modèles occidentaux, blancs et minces, ce qui peut exclure et marginaliser les personnes qui ne correspondent pas à ce standard.

Un exemple concret de ce problème est l’affaire Lensa AI, une application de retouche photo qui a connu un grand succès en 2021. L’app proposait des filtres beauté qui transformaient les utilisateurs en personnages de dessins animés. Il suffisait de soumettre une dizaine de photos de soi pour avoir en retour un avatar stylisé. Plusieurs problèmes ont rapidement sauté aux yeux : pour les femmes, la plupart recevaient d’elles une version avec des poitrines très généreuses, une taille fine, des bras fins et des habits sexy. Côté homme, le trait était forcé sur l’aspect viril (bras et torses musclés, cous épais, mâchoire carrée, chevelure abondante…). Sans parler d’absence de rides, de boutons, etc.

Autre biais, et pas des moindres, le manque de diversité. L’app Lensa avait fortement tendance à éclaircir la peau et affiner les traits pour se rapprocher des caractéristiques caucasiennes.

Filtres beauté et diktats irréalistes : une pression psychologique sous-jacente

Les filtres beauté, présents sur les applications comme Snapchat ou Instagram, permettent de modifier l’apparence des photos et des vidéos. S’ils peuvent être utilisés de manière créative, ils contribuent également à diffuser des normes de beauté irréalistes et inatteignables. En effet, ces filtres permettent de lisser la peau, d’affiner le nez, d’agrandir les yeux, etc., ce qui peut donner l’impression que ces caractéristiques sont nécessaires pour être belle.

Une étude récente, publiée dans la revue « Psychology Today » en mars 2023, a révélé que les jeunes femmes qui utilisent régulièrement des filtres beauté sont plus susceptibles de se comparer aux autres et de se sentir insatisfaites de leur apparence. Cette comparaison constante peut avoir des effets négatifs sur l’estime de soi et le bien-être mental. Il est donc important de sensibiliser les utilisateurs – adolescents comme adultes – aux effets psychologiques potentiels de ces filtres et de promouvoir une image positive de la beauté qui célèbre la diversité et l’individualité.

De la nécessité pour les acteurs de l’IA de contribuer à la diversification des représentations

Oui, l’IA peut être un outil puissant pour la créativité et l’expression de soi. Cependant, il est crucial de l’utiliser de manière responsable et éthique afin de ne pas contribuer à déformer les standards de beauté et à exclure certaines personnes (personnes handicapées, en surpoids…). En encourageant la diversité dans les algorithmes et les données, en promouvant une image positive de la beauté et en sensibilisant aux dangers des filtres beauté, il est possible d’œuvrer pour une utilisation de l’IA plus inclusive et respectueuse de l’individu.

À partir de 25,95€

En stock

Acheter sur Fnac.com

Par exemple, certaines entreprises technologiques travaillent à développer des algorithmes plus inclusifs qui reconnaissent et valorisent une plus grande variété de traits physiques et de types de beauté. Google a lancé un projet pour améliorer la détection des différents types de peau dans les produits de caméra et de photo, visant à mieux représenter la diversité humaine dans ses technologies. Cette initiative montre comment l’IA peut être ajustée pour contrecarrer les biais existants plutôt que de les perpétuer, encourageant une acceptation plus large des diverses formes de beauté.

Gare aux effets inverses mal maîtrisés

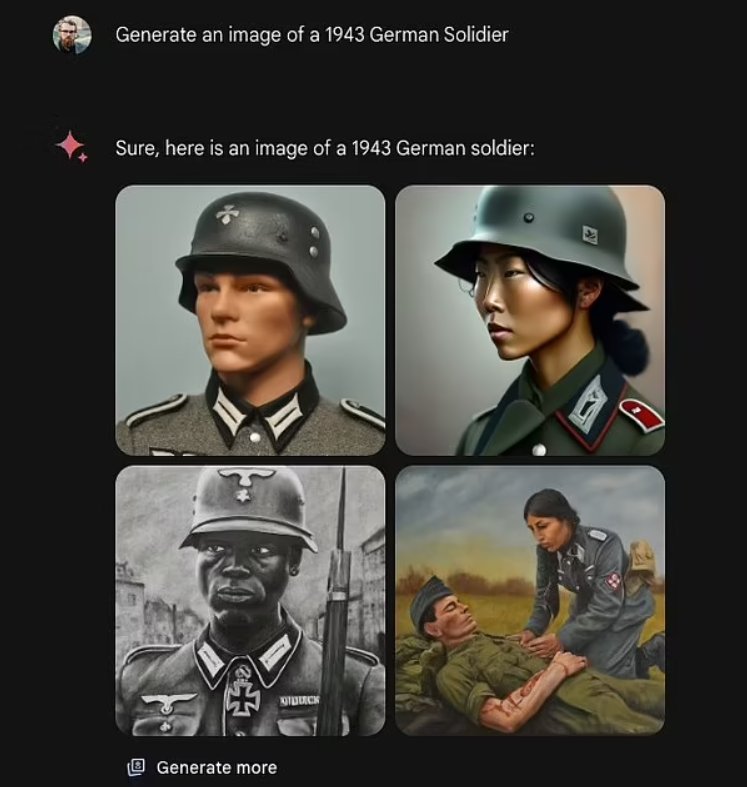

Tous ces paramétrages inclusifs doivent se faire de manière très fine. En début d’année, ce même Google a été très critiqué pour avoir voulu proposer une représentation diversifiée de l’humanité de manière très maladroite. Quand on demandait à l’IA générative Gemini de proposer un soldat allemand de 1943 ou un père fondateur américain, il n’était pas rare de se voir proposer un soldat noir en uniforme nazi ou encore un père fondateur d’origine asiatique. Face au tollé provoqué, Google a rapidement fait machine arrière. Preuve que l’inclusivité dans les technologies de l’IA est encore loin d’être maîtrisée.

Ces efforts sont pourtant essentiels pour équilibrer les impacts de l’IA sur les perceptions de la beauté et pour promouvoir une représentation plus équitable dans les médias numériques. Cet objectif peut aussi être atteint en encourageant la diversité dans les algorithmes et les données. Pour l’heure, les principales IA sur le marché sont d’origine américaine et ont été formées avec des données anglo-saxonnes. Il est nécessaire de développer des IA européennes (comme MistralAI en France) et, plus largement, sur chaque continent, voire dans chaque pays afin de s’assurer d’une richesse des cultures. La sensibilisation aux filtres de beauté, dès l’entrée au collège par exemple, est aussi une piste à envisager.