Depuis plusieurs années, l’intelligence artificielle s’invite dans les processus de recrutement. D’abord dans le tri des CV, mais aussi dans l’analyse d’entretiens vidéo. Plus rapide, plus efficace… Plus discriminante ?

Sur les plateformes de recherche d’emploi, difficile de savoir quand sa candidature va enfin passer devant un être humain. Il n’est pas rare qu’un algorithme dissèque d’abord le CV, ce qui est certes un gain de temps, mais qui suscite de l’inquiétude chez les candidats.

Plus pratique pour les recruteurs et les candidats

Si l’utilisation de l’intelligence artificielle pour le recrutement intéresse autant les entreprises, c’est avant tout pour des questions pratiques et de gain de temps. Cela est vrai aussi pour le candidat, qui peut passer plusieurs entretiens le même jour. Se développent aussi les entretiens vidéo différés, où le candidat s’enregistre en train de répondre à des questions. Une version qui peut arranger ceux qui travaillent déjà à temps plein, car, contrairement à un entretien classique, il peut être fait à n’importe quelle heure, même le week-end. Selon la plateforme, il peut être réenregistré en cas d’erreur, une aubaine pour les candidats trop nerveux ou peu préparés à l’exercice.

Des algorithmes encore difficiles à calibrer

En 2018, l’utilisation de l’IA dans le tri des CV avait provoqué un scandale chez Amazon aux États-Unis : elle avait déduit qu’il fallait forcément embaucher un homme pour le poste. Les biais ne signifient pas que la personne qui développe l’algorithme a de mauvaises intentions ; l’algorithme dépend des données de base (dataset). Si l’entreprise ou le service comprend une majorité d’hommes, l’algorithme peut croire que le sexe est un critère déterminant pour l’embauche. Les entreprises qui proposent des IA d’aide au recrutement, comme iCIMS ou Hirevue, affirment qu’elles vérifient régulièrement les résultats pour voir si un type de profil est privilégié ou exclu, afin de corriger l’algorithme.

Virginie Mathivet, docteure en intelligence artificielle, attire l’attention sur un autre type de profil qui pourrait être mis de côté : « Cela risque d’être discriminant pour les personnes en reconversion professionnelle, parce qu’elles n’ont pas ou peu d’expérience dans le domaine recherché. » Un profil atypique peut attirer l’attention d’un recruteur, mais une intelligence artificielle ne saura pas quoi en faire et n’arrivera pas à détecter son potentiel.

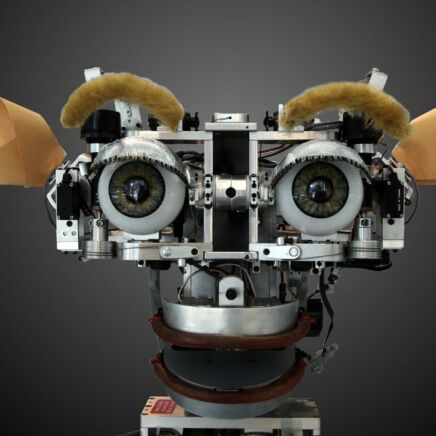

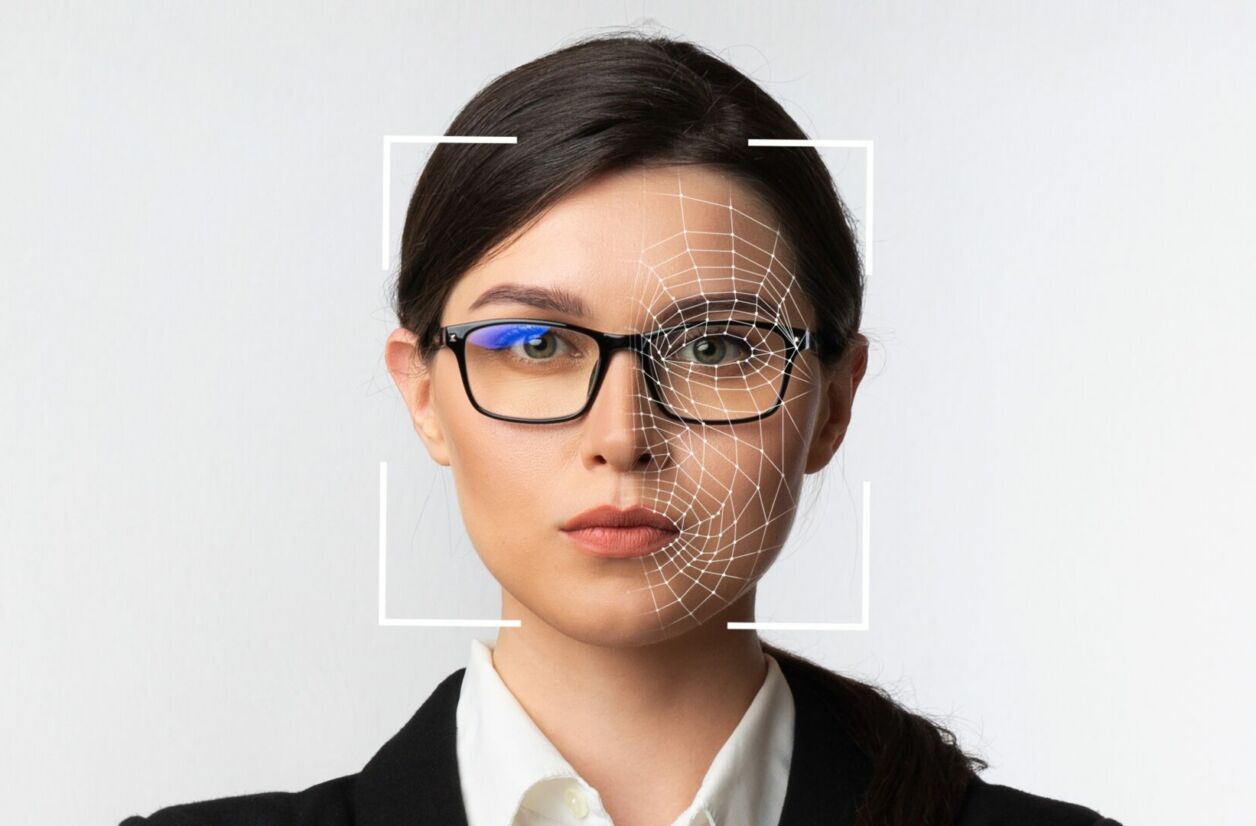

Dans le cadre de l’analyse de vidéos, plusieurs problèmes peuvent se poser. « Elle marche globalement bien, tant que votre culture est occidentale, sinon cela marche moins, explique Virginie Mathivet. Car chaque culture va exprimer différemment les émotions et les ressentis. » De plus, chez les personnes autistes ou handicapées (atteintes d’une paralysie faciale, par exemple), il peut y avoir des expressions faciales différentes ou des tics qui seraient mal interprétés par l’algorithme.

Premières remises en question, premières évolutions

En janvier 2021, HireVue a annoncé qu’il cessait l’analyse de la communication non verbale pour se concentrer sur l’analyse audio : « L’analyse visuelle a une corrélation bien moindre avec la performance professionnelle que d’autres éléments de notre algorithme. Le pouvoir prédictif du langage s’est grandement amélioré avec des avancées récentes en analyse du langage naturel et, par conséquent, nos algorithmes ne voient pas de différences significatives quand l’analyse visuelle est ajoutée aux données. »

D’autres utilisations de l’analyse visuelle sont envisagées. Le logiciel Cryfe se concentre ainsi sur l’analyse des émotions et la correspondance entre le verbal et le non verbal. La principale différence avec HireVue et iCIMS, c’est qu’il ne note pas les candidats et ne les trie pas lui-même. Caroline Matteucci, fondatrice de CM Profiling et créatrice de Cryfe, explique que l’objectif est de « créer un dialogue plus sincère et plus transparent, de rencontrer les personnes dans leur authenticité ». Le candidat peut donc aussi accéder aux résultats et voir quels moments de l’entretien ont posé problème. Pourquoi a-t-il répondu qu’une opportunité l’intéressait, si le langage non verbal montrait de l’ennui ou de l’inquiétude ? Ces questions peuvent servir de point de départ pour un second entretien. Caroline Matteucci ajoute que le logiciel peut aussi aider contre les biais d’un recruteur : « Si le recruteur ne vous aime pas trop, il va chercher inconsciemment des éléments pour confirmer cette impression, c’est ce qu’on appelle des biais de confirmation. S’il ne vous apprécie pas, il n’écoutera que 30 % de ce que vous dites. Cryfe fait office de troisième parti impartial, qui pourra donner une perspective différente. »

L’équilibre entre intelligence artificielle et être humain pourrait se situer là, avec une IA qui conseille, mais laisse les décisions au recruteur. Ces derniers sont donc loin d’être obsolètes. Pour éviter de possibles dérives de l’intelligence artificielle, notamment pour l’accès à l’emploi, la Commission européenne a publié en avril la première version de la réglementation sur l’intelligence artificielle.