La vice-présidente, Kamala Harris, a reçu les patrons d’OpenAI, Google, Microsoft et Anthropic pour discuter des risques de cette technologie.

Introduction

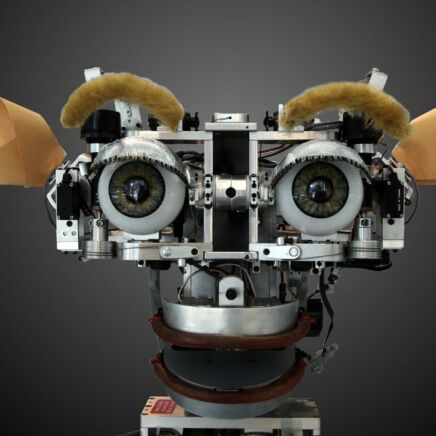

Avec le succès de ChatGPT et le lancement de chatbots similaires, la pression pour réglementer l’intelligence artificielle (IA) se fait sentir dans plusieurs pays. Après l’Union européenne et la Chine qui planchent sur de nouvelles règles pour encadrer ces systèmes, la Maison Blanche poursuit ses efforts pour en faire de même. Ce jeudi, la vice-présidente Kamala Harris, la secrétaire d’État au Commerce, Gina Raimondo, et d’autres hauts fonctionnaires ont échangé avec les patrons des géants de l’IA. Ont ainsi été conviés Sam Altman (OpenAI), Sundar Pichai (Google), Satya Nadella (Microsoft) et Dario Amodei (Anthropic).

Une responsabilité éthique, morale et légale

Lors de cette réunion, la vice-présidente a indiqué qu’il était impératif d’atténuer les risques actuels et potentiels que l’IA pose aux individus, à la société et à la sécurité nationale pour tirer parti des avantages qui pourraient découler des progrès de cette technologie. Les PDG des quatre entreprises ont été appelés à prendre des mesures pour assurer une innovation responsable et des garanties appropriées, mais aussi protéger les droits et la sécurité. « Comme je l’ai partagé avec les PDG d’entreprises à la pointe de l’innovation américaine en matière d’IA, le secteur privé a la responsabilité éthique, morale et légale d’assurer la sûreté et la sécurité de leurs produits », a déclaré Kamala Harris à la suite de cette réunion.

Cet échange a aussi été l’occasion d’avoir « des discussions franches et constructives sur trois domaines clés », à savoir « la nécessité pour les entreprises d’être plus transparentes avec les décideurs politiques, le public et les autres au sujet de leurs systèmes d’IA ; l’importance de pouvoir évaluer, vérifier et valider la sûreté, la sécurité et l’efficacité des systèmes d’IA ; et la nécessité de garantir que les systèmes d’IA sont protégés contre les acteurs malveillants et les attaques ».

Promouvoir une innovation responsable et atténuer les risques

La réunion fait partie d’un effort plus large et continu de la Maison Blanche visant à dialoguer avec des défenseurs, des entreprises, des organisations de défense des droits civiques et d’autres acteurs sur des questions critiques liées à l’IA. Il s’appuie sur des mesures prises pour promouvoir l’innovation responsable et l’atténuation des risques dans ce domaine. Parmi elles figurent des actions annoncées par la Maison Blanche avant la réunion. Elles incluent de nouveaux investissements pour alimenter la recherche et le développement, avec la Fondation nationale pour la science – agence indépendante du gouvernement – qui a annoncé un financement de 140 millions de dollars pour lancer sept nouveaux instituts nationaux de recherche sur l’IA.

Les principales entreprises du secteur se sont également engagées à participer à une évaluation publique de leurs systèmes d’IA à la DEF CON, l’une des plus importantes conventions de hackers au monde. « Cet exercice indépendant fournira des informations essentielles aux chercheurs et au public sur les impacts de ces modèles, et permettra aux entreprises et aux développeurs d’IA de prendre des mesures pour résoudre les problèmes rencontrés dans ces modèles. Le test des modèles d’IA indépendamment du gouvernement ou des entreprises qui les ont développés est un élément essentiel de leur évaluation efficace », a expliqué la Maison Blanche.