Selon l’agence de police européenne, les chatbots comme celui d’OpenAI peuvent être utilisés pour commettre des fraudes et d’autres cybercrimes.

Inquiet, Europol tire la sonnette d’alarme. L’agence de police européenne vient de publier un rapport dans lequel elle met en garde contre l’exploitation potentielle des systèmes d’intelligence artificielle (IA) comme ChatGPT par les criminels, qui offre « de sombres perspectives ». Ce document est le résultat de plusieurs ateliers organisés par son laboratoire d’innovation avec des experts en la matière, notamment afin d’« explorer les manières dont les criminels peuvent abuser des grands modèles de langage (LLM) » comme celui d’OpenAI.

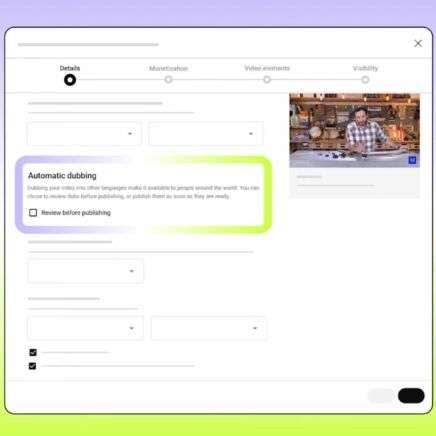

Il a examiné l’utilisation des chatbots dans son ensemble, mais s’est concentré sur ChatGPT, qui est le plus médiatisé et utilisé. Europol indique que les fonctionnalités de sécurité mises en place par OpenAI pour empêcher les utilisations malveillantes de son robot conversationnel ne sont pas suffisantes car plusieurs de ses garanties peuvent être contournées assez facilement.

Des abus potentiels inquiétants

Parmi les nombreux sujets de préoccupation identifiés par les experts de l’agence figurent notamment trois domaines de criminalité. Pour commencer, Europol s’inquiète de l’utilisation du chatbot d’OpenAI pour commettre des fraudes et de l’ingénierie sociale. « La capacité de ChatGPT à rédiger des textes hautement authentiques sur la base d’un prompt de l’utilisateur en fait un outil extrêmement utile à des fins de phishing », indique l’agence. Là où les fautes d’orthographe et les erreurs grammaticales évidentes permettaient de détecter facilement ce type d’escroqueries, les cybercriminels peuvent par exemple utiliser le robot conversationnel pour usurper l’identité d’un individu ou d’une organisation de manière réaliste. Cela, même s’ils disposent seulement d’une compréhension basique de la langue en question.

« Avec l’aide des LLM, ces types de phishing et de fraude en ligne peuvent être créés plus rapidement, de manière beaucoup plus authentique et à une échelle considérablement accrue », prévient Europol. Selon l’agence, ChatGPT peut aussi être utilisé à des fins de propagande et de désinformation vu qu’il permet aux utilisateurs de générer et de diffuser des messages reflétant un récit spécifique avec relativement peu d’efforts.

Enfin, Europol s’inquiète de la capacité du chatbot à produire du code dans plusieurs langages de programmation. « Pour un criminel potentiel avec peu de connaissances techniques, il s’agit d’une ressource inestimable pour produire du code malveillant », alerte-t-elle. L’agence précise en outre que les garanties d’OpenAI pour empêcher ChatGPT de générer du code potentiellement malveillant fonctionnent uniquement si ce dernier comprend ce qu’il fait. Autrement dit, un cybercriminel peut simplement diviser son prompt en étapes individuelles afin de contourner ces mesures de sécurité.

« L’objectif de ce rapport est de sensibiliser à l’utilisation abusive potentielle des LLM, d’ouvrir un dialogue avec les entreprises d’intelligence artificielle (IA) pour les aider à mettre en place de meilleures garanties et de promouvoir le développement de systèmes d’IA sûrs et fiables », fait savoir Europol. « À mesure que la technologie et que de nouveaux modèles deviennent disponibles, il deviendra de plus en plus important pour les forces de l’ordre de rester à l’avant-garde de ces développements afin d’anticiper et de prévenir les abus », conclut l’agence.