Depuis un peu plus d’un an, l’Union européenne travaille sur une proposition de loi sur l’intelligence artificielle. Elle ambitionne de s’imposer dans ce domaine en favorisant l’innovation, tout en réglementant cette technologie pour protéger les citoyens.

Introduction

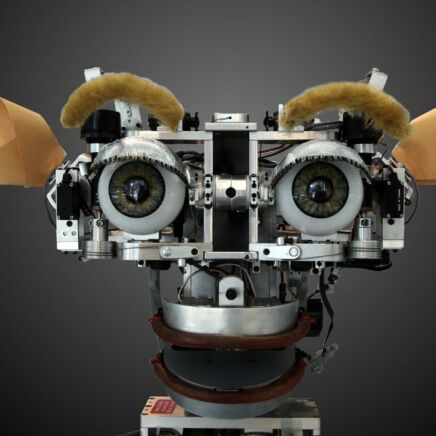

Malgré son potentiel et son utilité dans plusieurs domaines tels que la santé ou les transports, l’intelligence artificielle (IA) suscite encore des craintes quant aux risques qu’elle présente dans certaines applications. Plusieurs pays cherchent à réglementer cette technologie, à l’image de la Chine. Le 21 avril 2021, la Commission européenne a à son tour présenté une proposition de règles et d’actions afin de « faire de l’Europe le pôle mondial d’une intelligence artificielle digne de confiance ». Elle est censée garantir que les citoyens peuvent faire confiance à l’IA qu’ils utilisent.

« En établissant les normes, nous pouvons ouvrir la voie à une technologie éthique dans le monde entier, tout en préservant la compétitivité de l’UE. À l’épreuve du temps et propices à l’innovation, nos règles s’appliqueront lorsque c’est strictement nécessaire : quand la sécurité et les droits fondamentaux des citoyens de l’Union sont en jeu », avait alors expliqué Margrethe Vestager, vice-présidente exécutive de la Commission européenne. Mais quelles sont ces règles et où en est la proposition pour réglementer l’IA depuis l’année dernière ?

Une proposition de loi basée sur les risques

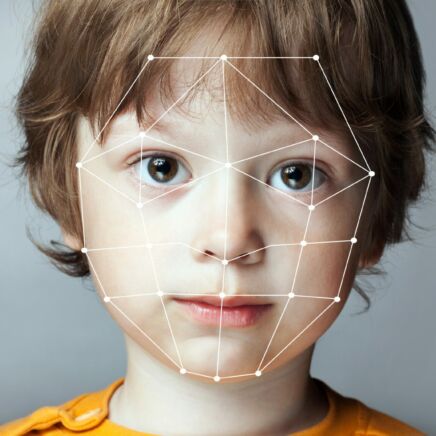

La proposition de règlement de la Commission européenne suit une approche fondée sur les risques. Elle a pour objectif de traiter ceux liés à des utilisations spécifiques de l’IA, à l’aide d’une catégorisation composée de quatre niveaux. Le premier, « risque inacceptable », concerne les systèmes vus comme « une menace évidente pour la sécurité, les moyens de subsistance et les droits des personnes ». Ainsi, les applications d’IA cherchant à priver les utilisateurs de leur libre arbitre en manipulant le comportement humain (jouet doté d’une assistance vocale incitant un mineur à avoir un comportement dangereux, etc.) ou encore les systèmes de notation sociale seraient interdits.

La catégorie « risque élevé » comprend les technologies utilisées dans divers domaines, comme celui de l’emploi, qui peuvent se révéler dangereuses. Dans le secteur professionnel, les logiciels de tri des CV pour les procédures de recrutement peuvent, par exemple, se montrer discriminants. Ces systèmes seraient tenus de se conformer à des obligations afin d’être mis sur le marché. Il serait, entre autres, obligatoire que les informations soient « claires et adéquates à l’intention de l’utilisateur ».

Le niveau « risque limité » inclut, lui, des obligations en termes de transparence pour les systèmes tels que les chatbots. Leurs utilisateurs devraient ainsi être informés du fait qu’ils interagissent avec une machine pour qu’ils puissent décider de poursuivre ou non leur interaction en connaissance de cause.

« La loi sur l’IA est très très différente, à la fois du Digital Markets Act et du Digital Services Act. (…) il s’agit beaucoup plus de façonner l’avenir dans cette approche consistant à examiner les cas d’utilisation de l’IA et cela la rend, je pense, plus difficile à gérer. »

Margrethe VestagerVice-présidente exécutive de la Commission européenne

Enfin, la dernière catégorie, « risque minime », implique d’autoriser l’utilisation libre d’applications telles que des jeux vidéo ou des filtres anti-spam reposant sur l’IA. Estimant qu’elles ne présentent qu’un risque minime ou nul pour les droits ou la sécurité des citoyens, la Commission ne prévoit pas de mesures pour ce domaine.

Ces règles sont associées à un plan coordonné sur l’IA, qui définit notamment la stratégie « pour accélérer les investissements dans les technologies d’intelligence artificielle afin de favoriser une reprise économique et sociale résiliente ». Cela passerait par la mise en place de conditions propices au développement et à l’adoption de l’IA au sein de l’UE (partage de données…).

Une faible avancée justifiée et critiquée

Un an après, la proposition de loi sur l’IA de la Commission européenne est toujours au stade de projet. Elle a donc peu avancé, surtout par rapport à d’autres projets de loi tels que le Digital Markets Act et le Digital Services Act présentés fin 2020 et récemment adoptés. Mais, pour Margrethe Vestager, cette lenteur est justifiée : « La loi sur l’IA est très très différente, à la fois du Digital Markets Act et du Digital Services Act. Dans la loi sur les services et dans la loi sur les marchés, ils se sont appuyés sur une expérience que nous avons acquise à partir d’affaires de concurrence, de pratiques commerciales déloyales, du comportement de nos plateformes et de la manière dont elles fournissent leurs services. En ce qui concerne la loi sur l’IA, il s’agit beaucoup plus de façonner l’avenir directement dans cette approche consistant à examiner les cas d’utilisation de l’IA et cela la rend, je pense, plus difficile à gérer », a indiqué la commissaire lors d’un sommet sur l’IA et la technologie organisé par Politico.

La lenteur de la proposition de règlement sur l’IA est cependant critiquée par d’autres personnalités politiques. C’est notamment le cas du député européen Axel Voss qui, en plus d’estimer que l’UE est trop lente, émet des critiques concernant le projet lui-même : « Nous sommes heureux de réglementer ici quelque chose et là quelque chose, et de nous améliorer un peu, mais il n’y a pas de plan ni de concept global (…) C’est toujours bien que tous nos États membres aient une stratégie d’IA, mais comment cela se relie-t-il ? Il faut s’unir, il faut monter des projets européens, sinon je ne vois pas comment on va être une sorte de concurrent sérieux », a-t-il déclaré.

« La police prédictive devrait être ajoutée parmi les pratiques interdites, car elle viole la présomption d’innocence ainsi que la dignité humaine. »

Rapport préliminaire sur l’IA pour la Commission européenneDragos Tudorache et Brando Benifei

Les États membres de l’UE disposent en effet de leur propre stratégie concernant l’IA. En France, elle a été annoncée par Emmanuel Macron en 2018, avec un budget de 1,5 milliard d’euros. Plus récemment, en novembre 2021, le gouvernement a dévoilé un plan de 2,2 milliards d’euros pour faire du pays « un champion de l’intelligence artificielle », en luttant contre la pénurie de talents français dans ce domaine et en investissant dans la recherche.

Entre innovation et réglementation

Concrètement, la proposition de loi sur l’IA a surtout fait l’objet de rapports indiquant ce qu’elle devrait impliquer. La notion de concurrence était d’ailleurs mentionnée dans l’un d’eux, publié en novembre dernier. Axel Voss y précisait que l’UE avait pris du retard dans cette « course technologique mondiale » dominée par les États-Unis et la Chine, et qu’elle devait intensifier ces efforts pour les rattraper. Il estimait que la future réglementation devrait se concentrer sur le potentiel de l’IA, accorder plus de place à l’innovation qu’à la régulation. « Si nous pensons uniquement dans cette dimension de protection et d’interdiction et ainsi de suite, nous ne créons pas d’idées innovantes, nous ne créons pas de technologie innovante », a-t-il expliqué.

D’autres membres du Parlement européen considèrent, en revanche, que certaines applications d’IA devraient être interdites. En avril, les eurodéputés Dragos Tudorache et Brando Benifei ont finalisé un rapport préliminaire sur l’IA, dans lequel ils indiquent vouloir interdire la prévision policière ou police prédictive. Elle consiste à utiliser des techniques d’analyse, en particulier des données, pour prévenir la criminalité. Cela permet de prédire la probabilité qu’une personne commette un crime ou récidive. « La police prédictive devrait être ajoutée parmi les pratiques interdites, car elle viole la présomption d’innocence ainsi que la dignité humaine », indique le rapport.

Ils souhaitent aussi étendre la liste des applications à haut risque pour qu’elle couvre les systèmes conçus pour interagir avec les enfants, les deepfakes ou encore les algorithmes avec un potentiel impact sur les processus démocratiques. Selon Brando Benifei, d’autres amendements seront ajoutés à la proposition lors d’une prochaine phase avec d’autres collègues du Parlement européen, dont Axel Voss. Cette future étape sera peut-être l’occasion de trouver le bon équilibre entre innovation et réglementation, ce qui s’annonce compliqué pour le moment, malgré la volonté de l’UE de proposer des IA fiables aux citoyens tout en n’empêchant pas le développement de ces technologies.