La Maison Blanche a annoncé avoir obtenu des engagements volontaires de Google, Meta ou encore OpenAI pour un développement sûr et transparent de cette technologie.

Introduction

La Maison Blanche poursuit ses efforts pour réglementer l’intelligence artificielle (IA). Après avoir rappelé les entreprises du secteur à leurs responsabilités en mai, elle vient d’obtenir les engagements de sept d’entre elles pour « évoluer vers un développement sûr, sécurisé et transparent » de cette technologie. C’est ce qu’elle a annoncé vendredi, à la suite d’une réunion entre le président Joe Biden et les dirigeants de sept sociétés, dont Google, OpenAI, Meta et Microsoft.

À travers ces engagements volontaires, les entreprises vont respecter « trois principes qui doivent être fondamentaux pour l’avenir de l’IA », à savoir la sûreté, la sécurité et la confiance, a indiqué la Maison Blanche dans un communiqué, ajoutant qu’il s’agit d’« une étape cruciale vers le développement d’une IA responsable ».

Assurer la sécurité et gagner la confiance du public

Pour commencer, les sept entreprises se sont engagées à s’assurer que leurs produits soient sûrs avant leur lancement. Pour cela, elles ont notamment accepté de réaliser des tests de sécurité, « qui seront effectués en partie par des experts indépendants », afin de protéger contre les risques majeurs de l’IA, tels que la biosécurité et la cybersécurité. Elles se sont par ailleurs engagées à investir dans la cybersécurité et à partager des informations pertinentes sur leurs outils avec les autorités et les chercheurs. Elles faciliteront ainsi la découverte et le signalement par des tiers des vulnérabilités de leurs systèmes d’IA.

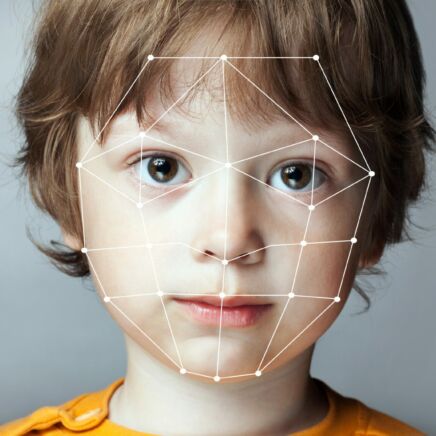

Afin de gagner la confiance du public, les sept entreprises ont accepté de « développer des techniques solides pour garantir que les utilisateurs sachent quand les contenus ont été générés par l’IA, comme un système de marquage en filigrane ». Selon la Maison Blanche, cela permettra de réduire les risques de fraude et de tromperie. Toujours dans cet objectif de gagner la confiance du public, les sociétés se sont également engagées à rendre compte publiquement des capacités, limites et domaines d’utilisation appropriée et inappropriée de leurs outils.

Enfin, elles vont « développer et déployer des systèmes d’IA avancés pour aider à relever les plus grands défis de la société », comme la prévention du cancer ou l’atténuation du changement climatique.