Les deux firmes ont déployé plusieurs fonctionnalités pour rendre leurs appareils accessibles aux personnes ayant un handicap visuel ou moteur, mais ont encore des progrès à faire.

Appeler, envoyer des messages, aller sur Internet, jouer… Le smartphone fait partie intégrante de notre quotidien. S’il nous facilite la vie en nous permettant de faire diverses choses à partir d’un seul appareil, son utilisation, elle, n’est pas simple pour tout le monde. Pour les utilisateurs souffrant de certains handicaps, il est en effet difficile de se servir du smartphone comme les autres, raison pour laquelle des fonctions spécifiques sont mises à leur disposition. Apple, dont l’iPhone 13 était le smartphone le plus vendu au monde début 2022, a d’ailleurs récemment annoncé une série de fonctionnalités qui leur sont destinées à l’occasion de la Journée mondiale de sensibilisation à l’accessibilité.

Les deux géants de la tech proposent déjà plusieurs outils pour aider les personnes handicapées à utiliser les smartphones disposant de leurs systèmes d’exploitation (iOS et Android), mais ces derniers ne sont pas toujours efficaces.

Pour les handicaps visuels, lecteur d’écran et paramètres d’affichage

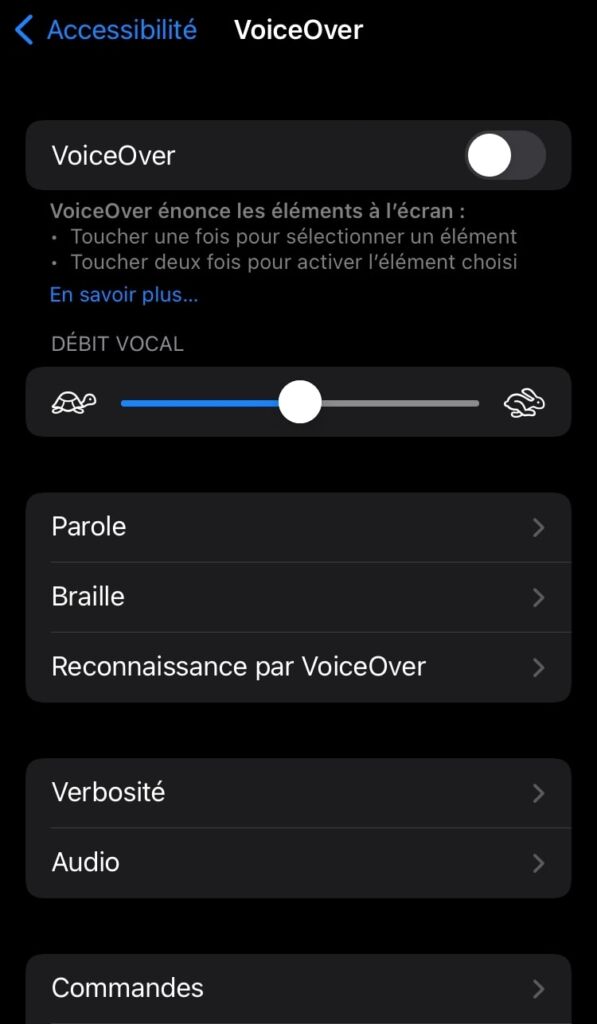

Plusieurs fonctions sont disponibles pour faciliter l’utilisation du smartphone par les personnes atteintes de handicaps visuels. La première d’entre elles est le lecteur d’écran – particulièrement utile pour les aveugles et malvoyants – qui permet de savoir ce qui se passe sur l’appareil grâce à des descriptions vocales. Appelé VoiceOver chez Apple et TalkBack chez Google, il retranscrit par synthèse vocale ou affiche sur une plage braille ce qui figure sur l’écran, aidant les individus à contrôler leur appareil et à interagir avec son contenu (notifications, applications, sites web…). Ils ont notamment la possibilité de le faire avec un clavier braille.

Cet outil présente cependant des limites, à commencer par le nombre de langues dans lequel il est proposé. Le lecteur d’écran d’Apple est par exemple disponible en français, en anglais, en espagnol et dans plus de 30 langues. La firme de Cupertino cherche à le rendre accessible dans plus de pays, en ajoutant 20 autres langues plus tard cette année. Autre problème : les lecteurs d’écran peuvent ne pas détecter des contenus, comme les liens de navigation mal codés. Autrement dit, ces derniers ne seront pas ignorés par ces outils et les utilisateurs devront les écouter chaque fois qu’une nouvelle page est chargée.

Une autre fonctionnalité d’Apple (Contenu énoncé) et de Google (Sélectionner pour prononcer) peut aussi être utilisée pour lire à voix haute le contenu de l’ensemble de l’écran ou des éléments sélectionnés. Les deux géants ont en outre inclus des options visant à améliorer la lisibilité et la visibilité pour aider les personnes souffrant de handicaps visuels à mieux lire et voir. Ils sont ainsi en mesure d’agrandir la taille du texte et des icônes ou encore de filtrer les couleurs sur le smartphone pour distinguer celles-ci plus facilement, ce qui peut d’ailleurs être utile aux daltoniens.

Des commandes alternatives pour les handicapés moteur

Des outils sont également disponibles pour aider les personnes atteintes de handicaps moteurs. Que ce soit avec Apple ou Google, elles ont la possibilité de faire appel au contrôle vocal qui – comme son nom l’indique – est un moyen de contrôler le smartphone à l’aide de sa voix. Ils sont ainsi en mesure d’ouvrir des applications, de rédiger des SMS ou encore de passer d’un écran à un autre comme le ferait une personne en touchant l’écran du smartphone.

Si le contrôle vocal est proposé en tant que fonctionnalité chez Apple, il est cependant nécessaire de télécharger l’application Voice Access pour les utilisateurs des téléphones tournant sous Android. De plus, ce type d’outil n’est pas encore parfait. Dans une page dédiée aux problèmes liés à son application, Google indique qu’il est par exemple possible que les commandes vocales ne soient pas reconnues ou que Voice Access se bloque au milieu d’une commande.

Ces handicapés peuvent également se servir d’une autre fonction pour utiliser leur smartphone plus facilement. Dénommée Contrôle de sélection chez Apple et Switch Access chez Google, elle permet notamment de contrôler le téléphone en attribuant une action (toucher, arrêter le curseur, aller à l’élément suivant, etc.) à un bouton comme le dos de l’appareil, l’écran ou les touches du volume. Elle aide les utilisateurs à sélectionner des éléments sur l’écran de leur smartphone par le biais de plusieurs méthodes telles que la mise en surbrillance.

Parmi les autres options incluses figure un menu d’accessibilité développé par Google pour contrôler un appareil Android. Depuis celui-ci – qui occupe une grande partie de l’écran – les utilisateurs sont capables de verrouiller l’écran, ouvrir les réglages rapides et les notifications, ou encore augmenter et réduire la luminosité. Cette fonction, appelée AssistiveTouch chez Apple, se présente sous la forme d’un bouton virtuel menant à un menu d’actions similaires à celles de Google. Des utilisateurs peuvent néanmoins rencontrer des problèmes avec cet outil : certains d’entre eux ont mentionné sur des forums de discussion un léger retard entre le moment où ils appuyaient sur le bouton virtuel et l’ouverture du menu d’actions à la suite de la mise à jour vers iOS 15.

Des fonctions à l’accessibilité limitée

L’une des options bien connues pour les personnes atteintes de handicaps auditifs sont les sous-titres. Alors qu’ils sont proposés par des réseaux sociaux pour les vidéos publiées sur leurs plateformes, ils sont également déployés par Google et Apple pour divers contenus. Le premier les rend disponibles pour les appels téléphoniques et vidéo, les messages audio, les podcasts et d’autres contenus multimédia. Il propose aussi l’application Transcription instantanée, qui serait capable de saisir des « nuances subtiles » telles que la différence entre « chat botté » et « chapeauté ». Il précise tout de même que des erreurs peuvent être présentes et que les sous-titres sont corrigés au fur et à mesure de la conversation étant donné que l’application est basée sur sa technologie de reconnaissance vocale. Autre alternative pour les appels téléphoniques : le texte en temps réel, avec lequel une personne est en mesure d’utiliser du texte pour communiquer et l’interlocuteur le voit à mesure qu’il est écrit.

Du côté d’Apple, les sous-titres sont uniquement utilisables dans des applications comme Apple TV, pour les films, les séries, les vidéos et les podcasts. Ils seront disponibles plus tard cette année pour les appels téléphoniques et FaceTime, les réseaux sociaux, les contenus multimédia et les applications de visioconférence. La firme dispose d’autres fonctions pour aider ces personnes, telles que l’outil Écoute en temps réel, qui facilite la conversation dans les lieux bruyants en approchant l’iPhone des personnes avec lesquelles son propriétaire discute. Capté par les micros de l’appareil, le contenu est ensuite transmis aux écouteurs sans fil (AirPods, AirPods Pro, AirPods Max, Powerbeats Pro) ou aux appareils auditifs compatibles avec l’iPhone afin de rendre les propos intelligibles. Un appareil sans fil est donc nécessaire pour utiliser cette fonction d’assistance, ce qui la rend moins accessible, d’autant plus que les écouteurs sans fil d’Apple sont vendus au prix minimum de 149 euros. Un reproche similaire peut être fait à Google : certaines prothèses auditives sont utilisables, mais uniquement avec les smartphones Pixel, soit les appareils conçus et commercialisés par l’entreprise.

Apple réserve également son amplificateur de conversation aux détenteurs d’AirPods Pro (279 euros). Cette fonctionnalité sert à percevoir plus distinctement les discussions dans les lieux bruyants ou très fréquentés, notamment à l’aide d’un traitement audio informatique. Les écouteurs se concentrent ainsi sur la personne qui parle afin d’aider à mieux distinguer sa voix et comprendre plus facilement les conversations en face à face. L’entreprise propose tout de même une option similaire utilisable avec des écouteurs classiques. Appelée Adaptation des écouteurs, elle permet justement de personnaliser les niveaux audio de ces derniers (amplifier les sons de faible intensité, ajuster des fréquences en fonction de son audition) notamment pour les contenus, afin de tout entendre de façon limpide. Cette fonction est aussi disponible sur les appareils Android par le biais de l’application Amplificateur de son.

Enfin, Apple a développé d’autres options n’ayant pas d’équivalent avec le système d’exploitation mobile de Google. Avec Audio mono, il est possible – comme son nom l’indique – de passer de l’audio stéréo à l’audio mono, soit d’avoir un son identique sortant des haut-parleurs gauche et droit. Cet outil permet en outre de régler la balance afin de centrer l’audio vers le canal droit ou gauche si une personne entend mieux d’une oreille que de l’autre et donc ne rien perdre d’un contenu. L’entreprise inclut aussi des alertes sensorielles pour être prévenu des appels, SMS ou encore des emails. Concrètement, une personne peut être notifiée d’un appel avec un clignotement de LED, l’affichage d’une photo de l’individu en train d’appeler et d’autres choses par une vibration.