Le texte ambitieux, et le premier du genre dans le monde, est officiellement entré en vigueur le 2 février dernier. On fait le point.

Introduction

Alors que l’intelligence artificielle s’invite partout, il est urgent d’ériger des garde-fous. C’est du moins l’avis de l’Union européenne, qui s’oppose sur ce point aux États-Unis de Donald Trump. Celui-ci a d’ores et déjà acté vouloir moins de régulations – et plus d’investissements – pour s’assurer de la suprématie de son pays en matière d’IA. À l’étude depuis 2023, l’AI Act vient tout juste d’entrer en vigueur dans les 27 pays de l’Union européenne. On vous en résume les grands principes.

À partir de 879,89€

En stock vendeur partenaire

Voir sur Fnac.com

1 À quoi sert l’AI Act européen ?

L’AI Act vise à encadrer le développement de l’intelligence artificielle sur le sol européen. L’idée est de mettre en place certaines règles empêchant les géants de la tech de, grossièrement, faire tout et n’importe quoi.

Au cœur du projet réside la volonté d’assurer la sécurité, la transparence et les droits fondamentaux des citoyens européens, tout en n’endiguant pas la marche de l’histoire. L’IA est là, et continuera de se développer, mais pas de façon débridée.

À lire aussi

2 Quelles mesures sont déjà adoptées ?

Pour l’heure, seuls quelques grands principes sont déjà en application. Un second volet de mesures entrera en vigueur le 1er août prochain. Aujourd’hui, le cadre général de l’AI Act interdit notamment :

- la mise en place de systèmes de notation sociale (tels que ceux observés en Chine) ;

- les technologies de « police prédictive », qui peuvent être biaisées par des critères discriminants ;

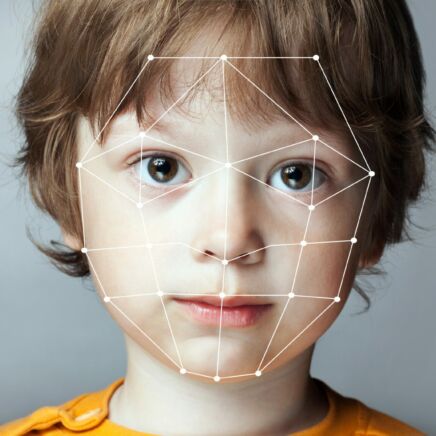

- la reconnaissance faciale en temps réel (à quelques exceptions près, comme pour les forces de l’ordre) ;

- la catégorisation biométrique, permettant de classer les individus en fonction de leur ethnie, leurs opinions politiques, leur orientation sexuelle ou leur appartenance syndicale ;

- la détection des émotions, en particulier dans un contexte scolaire ou professionnel, pouvant servir à établir des rapports de performance et de motivation.

3 ChatGPT va-t-il être moins performant à cause de cette loi ?

À partir du 1er août 2025, ce sont les modèles d’intelligence artificielle dits « à usage général » qui seront dans le viseur de l’AI Act. Les ChatGPT (OpenAI), Gemini (Google) ou Le Chat (Mistral) se verront ainsi imposer un certain nombre de règles à respecter :

- impératif de transparence : les entreprises conceptrices des IA génératives devront produire une documentation technique apportant notamment des précisions sur les données qui ont servi à l’apprentissage de ces intelligences artificielles ;

- il sera attendu des entreprises d’intelligence artificielle qu’elles réalisent des audits réguliers concernant les risques cyber ;

- les modèles jugés « à haut risque », notamment employés dans de grandes infrastructures énergétiques, étatiques ou administratives, feront l’objet d’une attention particulière, et devront voir leurs risques et biais évalués par des entités indépendantes.

Autant de mesures qui ne devraient donc nullement affecter la qualité du service fourni par les IA que vous pourriez utiliser au quotidien dans votre travail ou pour vos loisirs.

4 Comment l’Europe compte-t-elle contrôler et faire respecter le dispositif ?

Pour faire respecter ce dispositif, et éventuellement infliger des amendes pouvant aller jusqu’à 7 % du chiffre d’affaires mondial des entreprises qui feraient de la résistance, l’Europe se dote d’un nouveau Bureau de l’IA. Celui-ci sera domicilié à Bruxelles et travaillera de concert avec les autorités nationales de protection des données personnelles, comme la Cnil, ou encore la GPDP italienne, qui avait déjà fait bloquer ChatGPT, ou plus récemment DeepSeek.

5 L’AI Act va-t-il freiner l’innovation en matière d’IA ?

L’Europe et ce qui est parfois décrit comme un « millefeuille législatif » ou réglementaire sont régulièrement pointés du doigt par les acteurs américains qui, dans leur pays, ont les mains libres (et de plus en plus libres) pour développer les IA de façon débridée. L’AI Act est à ce titre vu comme un bâton dans les roues des géants de la tech, au même titre que le Digital Services Act (DSA) a pu l’être pour les réseaux sociaux.

Une incertitude réglementaire qui pousse même certains géants à jouer la prudence, comme Meta, qui n’a pas encore lancé son IA en Europe le temps de prendre le pouls de l’AI Act. On pense aussi à Apple et son IA Apple Intelligence, qui n’arrivera chez nous que dans quelques mois.

« L’AI Act donne un plan d’action pour améliorer la qualité de ces systèmes et donc […] favoriser l’innovation. Nous sommes sur des technologies encore très instables, qui peuvent commettre des erreurs et mettre en péril une entreprise si les risques ne sont pas bien maîtrisés. »

Kirsten RulfCo-autrice et négociatrice de l’EU AI Act

Pour autant, les régulateurs l’assurent : ce cadre est sain et permettra l’émergence d’une véritable concurrence européenne à ces grandes entreprises américaines (et chinoises), le tout dans un climat de confiance.