Meta, Microsoft, Google, OpenAI, TikTok et Adobe devraient signer un pacte ce vendredi, s’engageant à développer une technologie permettant d’identifier ces contenus trompeurs.

Introduction

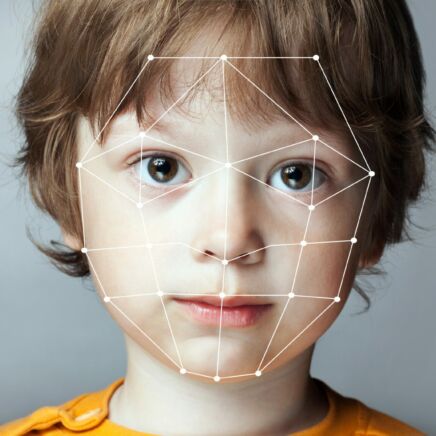

Si les deepfakes existent depuis plusieurs années, leur qualité s’est améliorée avec les progrès de l’intelligence artificielle (IA). Alors que l’année 2024 sera chargée en élections, les géants de la tech vont s’engager à développer de nouvelles techniques pour identifier les contenus de désinformation utilisant l’IA, rapporte l’AFP.

Plus précisément, Meta, Microsoft, Google, OpenAI, TikTok, Adobe et d’autres acteurs du secteur vont signer un pacte qui sera dévoilé vendredi en marge de la grande conférence de Munick sur la sécurité (MSC), selon les déclarations d’un porte-parole de Meta. L’objectif avec ce dernier est de lutter contre l’utilisation de l’IA pour tromper les électeurs, à l’aide d’outils permettant d’identifier, étiqueter et contrôler ces faux contenus, d’après le Washington Post, qui a révélé le premier cet accord.

Mieux lutter contre les dangers de l’IA

Reconnaissant que les contenus générés par l’IA, notamment avec leurs propres outils, présentent des risques pour des élections équitables, les signataires ne prévoient cependant pas d’interdire ces deepfakes politiques. Le pacte décrit les étapes pour tenter d’atténuer ces risques, comme la sensibilisation du public aux dangers de ces technologies. « La génération et la distribution intentionnelles et non divulguées de contenus électoraux d’IA trompeurs peuvent tromper le public de manière à compromettre l’intégrité des processus électoraux », indique-t-il.

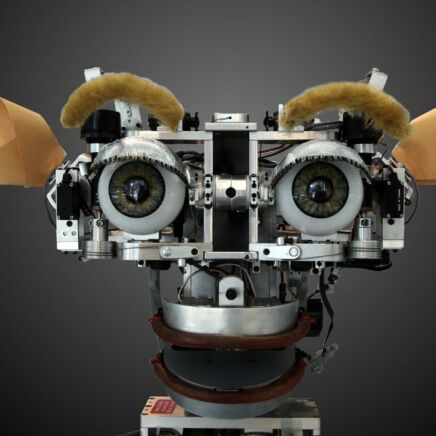

Cet accord intervient alors que plusieurs entreprises de la tech ont déjà pris des mesures pour éviter que les internautes soient induits en erreur avec les contenus générés par leurs outils. TikTok n’autorise pas les deepfakes de personnalités publiques lorsqu’ils sont utilisés à des fins politiques ou commerciales. YouTube oblige les créateurs à signaler les contenus générés par l’IA depuis peu. Plus récemment, OpenAI et Meta ont annoncé qu’ils allaient étiqueter les images créées par leurs outils dans un effort de transparence.