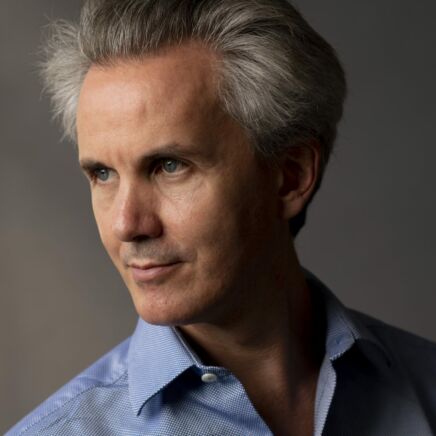

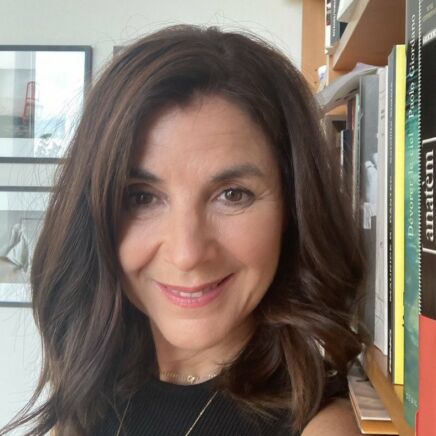

Directrice du Paris AI Research Institute, Isabelle Ryl a coécrit Géopolitique de l’IA avec Jamil Atif et J. Peter Burgess. Cet essai montre comment l’intelligence artificielle, en plus de bouleverser notre quotidien, a transformé les relations internationales et modifié les possibilités d’affrontement entre États.

Dans votre livre, vous réalisez un compte-rendu de l’état actuel de l’IA…

Aujourd’hui, l’intelligence artificielle est vue comme le fantasme de l’IA de science-fiction, des robots qui dominent le monde, etc., mais cela n’est pas du tout d’actualité. Elle est tout de même devenue une espèce d’outil extrêmement puissant capable d’améliorer les choses dans de nombreux secteurs d’activité, avec des usages très connus comme la recommandation de contenus ou le placement de publicités sur les réseaux sociaux. On la retrouve aussi dans d’autres domaines très médiatisés tels que la santé, pour détecter les cancers, analyser des données génétiques…, tout ce qui peut être systématisé à partir d’imageries. Les chaînes de logistique, soit le calcul du meilleur trajet ou la manière de remplir au mieux les camions, peuvent également être améliorées avec l’IA. Cette utilisation est cependant beaucoup moins médiatisée, car elle n’est pas aussi parlante pour le grand public que d’autres domaines.

Bien entendu, nous avons aussi les véhicules autonomes, la robotique et le traitement des langues, qui a fait des progrès faramineux dans les dix dernières années et peut, par exemple, être utilisé au quotidien lorsqu’une personne ne comprenant pas un mot dans une langue étrangère interroge un moteur de recherche. Le traitement des langues peut aussi servir aux entreprises de secteurs technologiques au sein desquels des techniciens interviennent dans tous les coins du monde. Dans le cas d’une panne sur une plateforme pétrolière, un puits de forage ou un autre type d’usine, il est possible que le technicien rédige un compte-rendu dans la langue de son pays, qui ne sera donc pas lisible par tout le monde. Une traduction automatique en anglais pour tout le monde est alors utile. Il y a ainsi vraiment des tas de secteurs dans lesquels on peut imaginer des applications de l’IA.

Manipulation de l’information, cyberattaques, robots tueurs… l’IA présente aussi de nombreux dangers, n’est-ce pas ?

Comme toutes les technologies, oui. Le nucléaire, dans la situation énergétique que l’on connaît, va probablement nous apporter beaucoup dans les hivers qui viennent, mais il peut aussi être utilisé pour des choses beaucoup moins élégantes. C’est la même chose avec l’IA, à la différence peut-être qu’il s’agit d’une technologie que les citoyens ne voient pas immédiatement. Dans l’éducation par exemple, des travaux et des logiciels commencent à être proposés pour aider les enfants à réviser ou adapter le contenu d’un cours à un enfant particulier grâce à l’IA. Cette application de l’IA est intéressante pour les parents qui ne sont pas en mesure d’aider les enfants à faire leurs devoirs ou de les entraîner sur certains sujets. Cela peut, en revanche, être extrêmement grave s’il y a un biais au sein des logiciels, puisque ça touche vraiment la manière dont les enfants apprennent : on pourrait imaginer essayer de former les jeunes esprits à des raisonnements particuliers ou tenter de leur inculquer certaines croyances.

« À partir du moment où l’IA est une technologie qui s’insinue partout et qui n’est pas forcément bien maîtrisée par l’usager final, on peut arriver à des manipulations d’ampleur très importante, ce qui me paraît extrêmement dangereux, probablement plus que les robots tueurs à ce stade. »

Isabelle RylDirectrice du Paris AI Research Institute

Les dangers sont donc bien plus que “juste” la perspective des robots tueurs. À partir du moment où l’IA est une technologie qui s’insinue partout et qui n’est pas forcément bien maîtrisée par l’usager final, on peut arriver à des manipulations d’ampleur très importante, ce qui me paraît extrêmement dangereux, probablement plus que les robots tueurs à ce stade. Le fait que les gens, quand ils voient une vidéo sur YouTube, ne soient pas capables de déterminer si elle est vraie ou fausse ou ne se posent simplement pas la question est problématique, car cela permet de les manipuler. Les systèmes qui recommandent des contenus en se basant sur votre historique, soit en se basant sur ce que vous avez déjà consulté, ce qui semble vous plaire… vous enferment dans votre façon de penser et vous empêchent d’être confronté aux points de vue qui, justement, ne sont pas le vôtre et peuvent peut-être vous bousculer un peu.

Pouvez-vous revenir sur les trois piliers de la bataille pour le leadership de l’IA ?

La technologie, les infrastructures et les données sont nécessaires pour développer les systèmes tels qu’ils sont aujourd’hui. La plupart des technologies très visibles ou ayant eu de gros impacts sont basées sur des progrès algorithmiques, des progrès dans la manière dont ces systèmes sont conçus, dans les méthodes inventées pour encoder les choses. Cela est basé sur des découvertes et des avancées en recherche, sur la présence de chercheurs et d’ingénieurs de qualité. Autrement dit, tout ce qui est lié à l’humain. Beaucoup de ces avancées se fondent également sur de grandes ressources de calcul et de grandes quantités de données. Les trois sont donc nécessaires pour parvenir à des choses, comme le modèle de langage GPT-3, qui est très performant.

Votre livre est aussi un rappel des différentes stratégies des pays pour l’IA.

Au sujet de la captation de données, les géants des États-Unis ont pris une avancée considérable, car ils ont commencé avant tout le monde et ont aujourd’hui la mainmise sur la plupart des réseaux sociaux. Ils disposent aussi d’infrastructures très importantes. La Chine a également développé pas mal de choses. L’Europe n’est, elle, pas dans une position si favorable. De grands plans ont été lancés avec des tentatives pour faire émerger des champions et rattraper les retards, grâce auxquels l’Europe va dans la bonne direction.

Il y a par exemple eu un investissement massif de l’État français dans la création du supercalculateur Jean Zay dédié à la recherche en IA. Il a considérablement changé les choses, car les universités françaises et les groupes de recherche ne sont pas tous en mesure d’acheter autant de ressources de calcul et le fait de les avoir mises à leur disposition leur permet de développer leurs travaux. Il n’est évidemment pas aussi gros que les supercalculateurs de Facebook ou Google, mais il est déjà extrêmement performant.

« Aujourd’hui, il faut tenter de se positionner sur la prochaine innovation et, pour ça, l’Europe a ou peut avoir le premier des trois piliers : la maîtrise de la technologie. Car elle a de très bons chercheurs et ingénieurs, et cela reste la matière première essentielle pour innover. »

Isabelle RylDirectrice du Paris AI Research Institute

Il y a aussi l’idée que, d’un point de vue très personnel, ça ne sert à rien d’essayer de construire le prochain Facebook ou le prochain Google. Ces deux entreprises existent déjà, elles ont pris le marché, même si la première s’est recentrée sur autre chose. Aujourd’hui, ce qu’il faut faire, c’est tenter de se positionner sur la prochaine innovation et, pour ça, l’Europe a ou peut avoir le premier des trois piliers : la maîtrise de la technologie. Car elle a de très bons chercheurs et ingénieurs, et cela reste la matière première essentielle pour innover. On tente de réinternaliser, de se repositionner sur les ressources de calcul, de créer de grands centres, de réimplanter des capacités de production sur le sol européen, etc. Ce n’est pas encore gagné, mais il y a de grands plans nationaux pour y parvenir.

Après, il restera la course à la donnée pour laquelle, pour l’instant, l’Europe a déjà pris un virage en essayant de ne plus laisser capter les informations de ses citoyens grâce à la régulation ou à la prise de conscience pour chacun d’eux de ce qu’il est en train de donner. Le fait d’en parler, d’exposer ce débat n’empêche pas les usages des différentes plateformes ou les débordements, mais, au moins, cela sensibilise les usagers finaux à réfléchir à ce qu’ils font quand ils acceptent de transférer leurs données n’importe où. C’est déjà le début de quelque chose.

Quelle est la place des géants du numérique ?

On peut les voir comme des quasi-États, parce qu’ils ont aujourd’hui une puissance très importante, ils se permettent d’aller sur des terrains jusque-là réservés aux États, comme la monnaie, la finance ou la possession de câbles sous-marins. Ils font aussi du lobbying auprès des instances, que ce soit à Bruxelles ou aux États-Unis, et ont quasiment l’équivalent d’ambassadeurs… Donc on peut les mettre sur le même plan que des États.

D’un autre côté, ils sont toujours soumis au contrôle des États auxquels ils appartiennent. Meta (ex-Facebook) ne fait pas ce qu’il veut aux États-Unis, il est épisodiquement convoqué par des commissions sénatoriales qui lui demandent de rendre des comptes. Ces entreprises sont également soumises aux lois antitrust, etc. La même chose s’est produite en Chine. Il y a donc une sorte d’équilibre ou de double jeu entre le fait que les États ont besoin de géants pour dominer le secteur économique – ce n’est pas pour rien que l’Europe aimerait voir émerger ses propres géants –, mais, en même temps, ont besoin de leur tenir un peu la bride pour ne pas se faire dépasser.

Pourquoi l’IA est-elle un enjeu géopolitique ?

L’IA est un nouvel enjeu parce que c’est une ressource que les États se disputent au même titre que l’eau. C’est l’objet d’une compétition entre les pays et c’est aussi un outil de positionnement, car il permet d’avoir une projection de leur puissance. En ce sens, l’IA est vraiment un outil important d’influence et en même temps – c’est l’objet de la troisième partie – c’est quelque chose qui change fondamentalement la manière dont on conçoit la géopolitique, parce qu’on est dans un espace qui n’est plus régi par les mêmes règles, les mêmes frontières, les mêmes codes.

Géopolitique de l’IA, les relations internationales à l’ère de la mise en données du monde, Jamal Atif, J. Peter Burgess et Isabelle Ryl, éditions Le Cavalier bleu, 19,90 €.