Deux développeurs ont sorti un outil de création de portrait-robot hyperréaliste avec l’aide de l’IA. Ce logiciel pourrait en réalité être contre-productif.

Depuis quelques mois, les IA génératives d’images ne cessent de progresser… et de déclencher des polémiques. Ajoutons à cela toutes les controverses sur l’utilisation des technologies par les forces de l’ordre, que ce soit pour prédire les crimes ou même se doter de robots tueurs, et on se retrouve avec un outil qui impressionne autant qu’il pose question.

Créer plus rapidement et plus précisément

Artur Fortunato et Filipe Reynaud ont développé ce logiciel lors d’un hackathon — une compétition entre programmeurs — autour d’OpenAI en décembre 2022. Dans leur présentation, ils expliquent que dessiner un portrait-robot traditionnel à la main peut décaler une enquête policière de plusieurs jours : il faut que le témoin et le portraitiste soient là au même moment et le dessin lui-même peut prendre quelques heures.

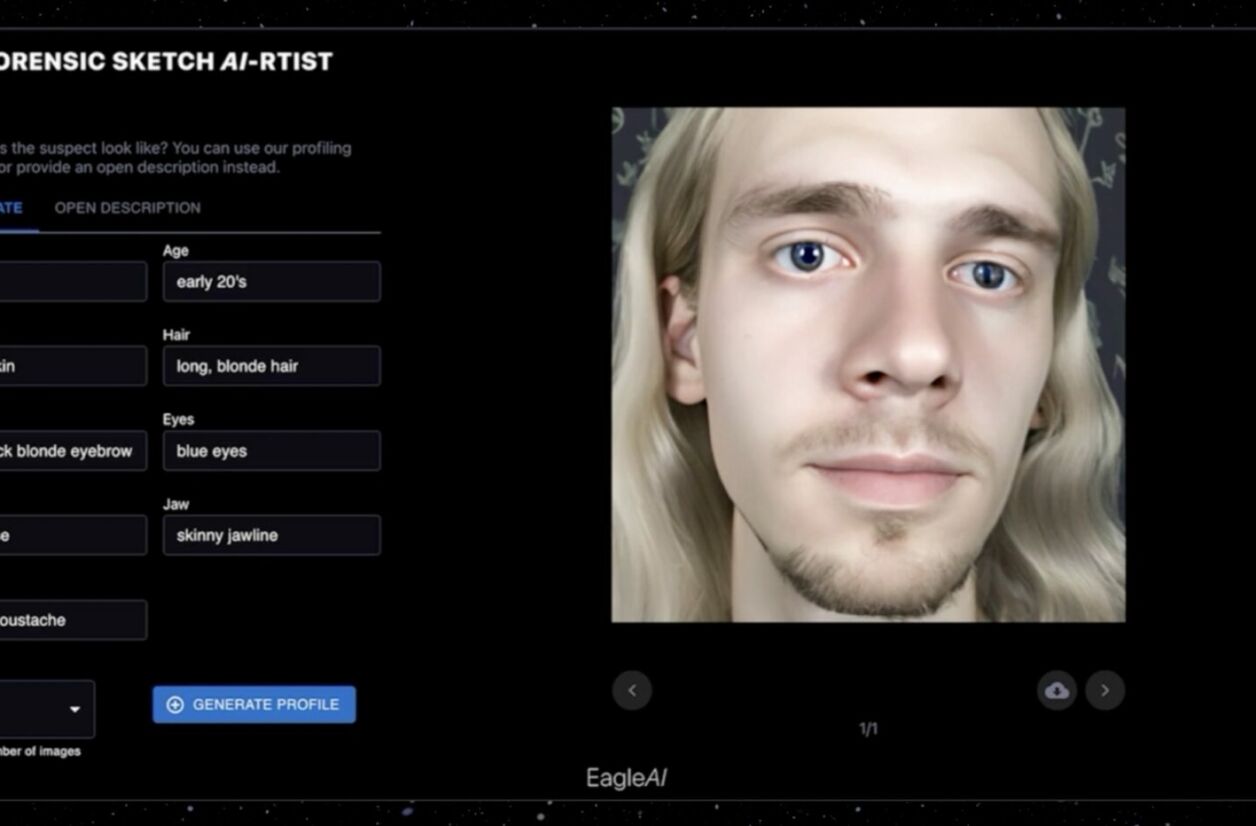

C’est pourquoi ils ont créé leur outil Forensic Sketch AI-rtist : il suffit de donner des indications textuelles au logiciel (comme le sexe, la couleur de peau, l’âge, les cheveux, la présence de pilosité faciale ou de signes distinctifs, etc.) pour que ce dernier génère un portrait réaliste. Il serait donc possible pour n’importe quel policier de créer un portrait-robot.

Pourquoi ça pose problème ?

Pour Jennifer Lynch, experte en cybersurveillance auprès de l’Electronic Frontier Foundation, le problème des portraits-robots n’est pas le temps qu’ils prennent à être réalisés : « Le problème, c’est que tout portrait-robot est déjà sujet à des biais et à la fragilité de la mémoire humaine, explique-t-elle à Vice. L’IA ne peut pas résoudre ces problèmes humains et ce programme en particulier les empirera sûrement. » Les experts s’inquiètent en particulier des biais racistes qui peuvent déjà être présents dans les algorithmes.

L’aspect hyperréaliste de ces portraits peut lui aussi poser problème, ajoute Jennifer Lynch : « Des études montrent que les humains se souviennent des visages de manière globale, plutôt que trait par trait. Un portrait-robot qui s’appuie sur des descriptions de traits individuels comme dans ce programme d’IA peut donner un visage qui est radicalement différent de celui du criminel. Malheureusement, une fois que le témoin voit le portrait-robot, cette image peut remplacer, dans son esprit, son vague souvenir du suspect. Cela sera accentué avec une image générée par IA qui aura l’air plus ‘réelle’ qu’un dessin réalisé à la main. »

Pour l’instant, ce logiciel n’est encore qu’un test et les développeurs ont affirmé qu’ils souhaitaient d’abord savoir s’il est vraiment utilisable en conditions réelles en discutant avec des services de police.