Dans un rapport, l’agence européenne de police explique que cette technologie est susceptible de devenir un « outil de base » pour le crime organisé.

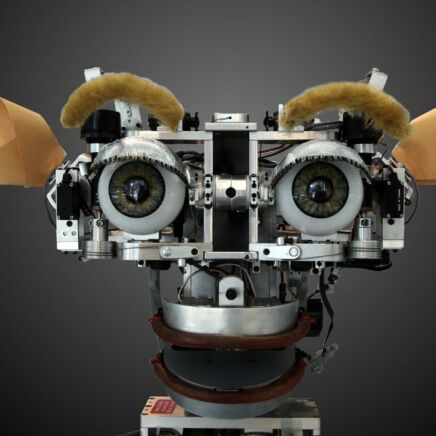

Les deepfakes, ces vidéos altérées grâce à l’intelligence artificielle (IA), sont principalement utilisés dans un but malveillant. Montrant de manière plus ou moins convaincante des individus dire ou faire des choses qu’ils n’ont jamais dites ou faites, ils peuvent servir à désinformer le public, influencer des élections ou encore contribuer à la fraude. Pour Europol, l’agence européenne de police, le deepfake pourrait devenir un « outil de base » pour le crime organisé. Elle vient de publier un rapport dans lequel elle indique que le volume croissant de ces vidéos sapent la confiance dans les autorités et les faits officiels.

L’agence cite plusieurs exemples de deepfakes dans son rapport, dont celui du président ukrainien dans lequel il annonçait sa reddition et appelait les citoyens à rendre les armes. Ces vidéos altérées pourraient aboutir à une situation parfois appelée « apocalypse de l’information », où une confusion sociale serait créée par rapport à la fiabilité des sources d’information. C’est pour cela qu’Europol estime « essentiel d’être conscient de cette manipulation et être prêt à faire face au phénomène ».

Une technologie utile dans le milieu criminel

Avec les progrès de l’IA, l’agence considère que la détection et la prévention des deepfakes doivent être la priorité absolue des forces de l’ordre car ces fausses vidéos peuvent faciliter des activités criminelles. Parmi elles, le harcèlement des individus en ligne, la falsification d’identités sur Internet, la pornographie non consensuelle ainsi que la manipulation de preuves électroniques pour des enquêtes judiciaires. Europol affirme que les forces de l’ordre seront obligées de développer de nouvelles compétences pour suivre le rythme de l’utilisation criminelle des deepfakes.

Outre le besoin de perfectionner leur main-d’œuvre pour les détecter, elles devront également « investir dans leurs capacités techniques afin de relever efficacement les défis à venir tout en respectant les droits fondamentaux ». Il sera, par exemple, nécessaire qu’elles utilisent des mesures de protection techniques et organisationnelles contre la falsification pour être capable de prouver l’authenticité des images.

D’un autre côté, Europol précise que la plupart des deepfakes peuvent être détectés manuellement. Ces vidéos peuvent en effet contenir des incohérences repérables par les humains, telles que le flou autour des bords du visage, la réflexion de la lumière dans les yeux ou l’absence de clignement. Il s’agit, cependant, d’une tâche intensive et pour laquelle une formation appropriée est nécessaire afin de se familiariser avec tous les signes pertinents, selon l’agence.