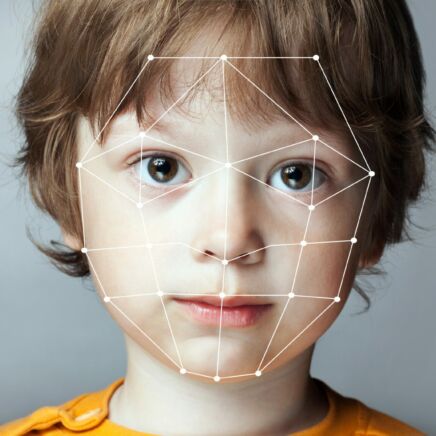

Face à la menace des deepfakes, de plus en plus difficiles à repérer, le tatouage numérique est vu comme un moyen de prouver l’authenticité et la traçabilité d’un contenu.

Introduction

Avec les progrès de l’intelligence artificielle (IA), il est de plus en difficile de détecter les deepfakes. Cette technique, aussi connue sous le nom d’hypertrucage, permet de remplacer un visage par celui d’un autre ou de falsifier ses propos avec réalisme dans une vidéo. Si ces faux contenus peuvent être créés dans un intérêt ludique, le problème est qu’ils peuvent aussi être nocifs, étant utilisés par des acteurs malveillants pour arnaquer des individus ou encore faire tenir des propos racistes, transphobes et violents à des personnalités.

Alors que des indices – ou plutôt des erreurs – permettent de repérer les deepfakes, cela devient de plus en plus compliqué avec les IA génératives comme Midjourney ou Dall-E, capables de créer des images très réalistes, comme on a pu le voir avec le Pape en doudoune blanche. Face aux difficultés des humains et des machines à détecter ces faux contenus, une autre méthode existe : le tatouage numérique. Explications.

Le tatouage numérique, une nouveauté pour les deepfakes

À l’origine, le tatouage numérique était plutôt utilisé pour le copyright, afin de défendre le droit de propriété des œuvres numériques. « Il s’agit d’ajouter une sorte de bruit non visible dans l’image, la vidéo ou l’audio », explique Jean-Luc Dugelay, professeur en sécurité informatique à Eurecom, une école d’ingénieurs. Lu par un détecteur, un programme informatique, ce tatouage peut être fragile ou robuste. Dans le premier cas, il se dégrade lorsque le contenu auquel il est intégré a été modifié. Il permet ainsi de savoir qu’une image, une vidéo ou un audio ont été modifiés. Dans le second, le tatouage est un moyen de retrouver l’origine du contenu ou son propriétaire. Autrement dit, même si un contenu a été transformé, il sera toujours possible de savoir qui a créé l’original.

Ces deux approches sont aujourd’hui utilisées pour les deepfakes, mais cela est encore assez nouveau. Apparu à la fin des années 1990, ce n’est que depuis quelques années que le tatouage numérique est étudié pour ces contenus altérés à l’aide de l’IA. « Il y a un renouveau. Depuis quelques temps, des gens cherchent à revitaliser le domaine du tatouage, à le repenser comme il y a dix ans pour de nouvelles fonctionnalités et, entre autres, protéger des deepfakes », indique Jean-Luc Dugelay.

« Les humains n’arrivent plus à détecter les erreurs et ça devient de plus en dur pour les machines. »

Jean-Luc DugelayProfesseur en sécurité informatique à Eurecom

En 2019, une équipe de l’Université de New York a par exemple présenté son projet de recherche consistant à marquer des contenus photographiés avec des « filigranes numériques » extrêmement sensibles à la manipulation. Il s’agit d’un processus optimisé pour être intégré dans un appareil photo, qui permettrait de marquer et de suivre toutes les modifications opérées sur une image pendant son cycle de vie, mais aussi d’authentifier la photographie d’origine. « Ces filigranes peuvent survivre au post-traitement ; cependant, ils sont assez fragiles en matière de modification : si vous modifiez l’image, le filigrane se casse », a expliqué Nasir Memon, professeur d’informatique et d’ingénierie à l’Université de New York. « Si la caméra elle-même produit une image plus sensible à la falsification, tout ajustement sera détecté avec une forte probabilité », a-t-il ajouté.

Une méthode efficace, mais problématique

Si le tatouage numérique est vu comme un moyen fiable pour détecter les deepfakes, il présente tout de même « un grave problème », selon Jean-Luc Dugelay : il nécessite de protéger un contenu avant de le rendre disponible en le publiant sur Internet. « Il faut se préparer à l’avance, ce qui veut dire que vous ne pouvez plus diffuser vos vidéos sur Internet ou ailleurs sans les avoir protégées d’abord », a déclaré le professeur en sécurité informatique.

Là est toute la différence avec l’approche passive, consistant à essayer de détecter qu’un contenu a été modifié en l’observant, afin de trouver des erreurs de fabrication. « Quand vous créez un deepfake, aussi bien audio que vidéo, vous avez encore des erreurs plus ou moins visibles. Et, même si elles ne sont pas visibles par l’humain, la machine peut les détecter. Mais on voit de plus en plus que cela ne suffit pas : les humains n’arrivent plus à détecter les erreurs et ça devient de plus en dur pour les machines », alerte Jean-Luc Dugelay.

Un détecteur adapté à une personne donnée

Le tatouage numérique n’est pas la seule méthode faisant l’objet de recherches pour détecter les deepfakes. Eurecom travaille par exemple avec l’Institut de recherche et coordination acoustique/musique (Ircam) sur un projet – DeTOX – visant à « implémenter et à apprendre des algorithmes de détection de deepfakes personnalisés sur des individus pour lesquels on peut disposer et/ou fabriquer de nombreuses séquences audio-vidéo réelles et falsifiées » depuis le début de l’année. Financé par le programme Astrid (pour Accompagnement spécifique des travaux de recherche et d’innovation défense) pour une durée de deux ans, il reposera sur trois détecteurs (pur audio, pur vidéo et audio-vidéo), ayant pour objectif de lutter contre les vidéos hypertruquées de personnalités françaises.

Comme l’explique Jean-Luc Dugelay, le but n’est pas d’avoir un détecteur universel ou de savoir si une vidéo est fausse ou pas, mais plutôt de se demander s’il s’agit, par exemple, d’une vraie vidéo ou d’un deepfake d’Emmanuel Macron. « Pour rendre la détection moins difficile, on va se spécialiser sur des personnalités particulières, donc on aura un détecteur adapté pour une personne donnée », indique le professeur de sécurité informatique.

Avec cette approche, Eurecom et l’Ircam affirment qu’il est possible d’obtenir un détecteur efficace, même face à des générateurs de deepfakes encore non répertoriés. Chacun ayant ses défauts, il peut être plus facile de détecter un contenu truqué si on a déjà été confronté à des vidéos créés à l’aide de ce dernier. Mais, si les deepfakes sont déjà difficiles à repérer, ils le sont encore plus si le générateur est inconnu. Reste à voir si le tatouage numérique et ces futurs détecteurs seront efficaces « dans un monde où l’on sait que l’audio, les vidéos ou les images peuvent inclure des choses qui n’existent pas », comme l’indique Jean-Luc Dugelay.