Une nouvelle étude du MIT Technology Review dresse un bilan désastreux de la consommation énergétique de la création de vidéos par intelligence artificielle.

L’institut technologique du Massachusetts (MIT) publie une étude enrichissante sur la consommation énergétique, et en particulier électrique, de l’utilisation de l’intelligence artificielle. Alors que de nouveaux data centers poussent aux quatre coins du globe et que les politiques publiques, notamment américaines, visent à un débridage total en matière d’adoption de l’IA, ce nouveau constat fait froid dans le dos. On imagine à peine le moral des experts du GIEC.

La consommation de la génération de vidéos dans le viseur

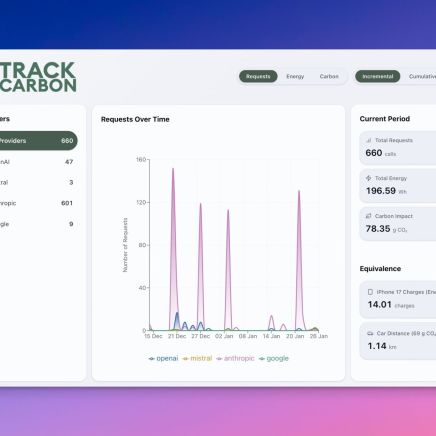

Alors que les moteurs de génération de vidéos par IA (autrement dit : de deepfakes) se perfectionnent et qu’OpenAI se prépare à intégrer son Sora 2 directement à ChatGPT, le MIT alerte sur la consommation folle de ce genre de technologie. On sait déjà que la moindre requête sur un chatbot d’IA consomme une quantité d’eau astronomique. On sait désormais combien d’électricité est dépensée pour chaque interaction avec ChatGPT : entre 114 et 6 706 joules, estime l’institut de recherche.

Si le chiffre n’est pas très parlant, l’exemple utilisé l’est beaucoup plus. Cela représente la différence entre faire tourner un micro-ondes pendant 0,10 seconde et pendant huit secondes. Plus le modèle de langage est perfectionné, plus il consomme d’électricité en raison du nombre de paramètres mobilisés par le chatbot. En d’autres termes : pour consommer moins, mieux vaut privilégier les modèles les moins capables… mais on augmente alors la marge d’erreur.

Plus inquiétant encore : la génération de vidéos fait littéralement exploser les compteurs. Pour créer une vidéo de cinq secondes par IA, le dernier modèle en date d’OpenAI consomme 3,4 millions de joules. L’équivalent d’un micro-ondes qui tourne pendant une heure… et 700 fois plus d’énergie que pour générer une image en haute qualité.

IA et écologie semblent irréconciliables

Pour panacher un peu leurs observations, les chercheurs du MIT ont alors fait un test : poser à un chatbot 15 questions et générer dix images, et trois vidéos de cinq secondes. Bilan des courses ? 2,9 kWh consommés en quelques minutes. Le MIT Technology Review reprend sa comparaison : c’est un micro-ondes qui tourne sans s’arrêter pendant 3h30.

Le rapport ajoute qu’avant l’émergence de l’IA à partir de 2022, la consommation des data centers, bien qu’élevée, était relativement stable et maîtrisée. Depuis que l’intelligence artificielle s’est invitée partout, les centres de données subissent les assauts d’internautes avides d’essayer le dernier modèle à la mode, conduisant à des surcharges importantes et à une consommation qui part en flèche. L’énergie consommée par les data centers aux États-Unis a doublé depuis 2017, et plus de la moitié de l’électricité de ces infrastructures sera intégralement fléchée vers les outils d’IA dès 2028.

Cette situation n’est pas près de s’arranger. Pour pallier le problème, on construit davantage de data centers, qui appauvrissent les sols et assèchent les rivières. La faune et la flore se font déloger et le désastre écologique qui se joue devant nous depuis des décennies s’aggrave encore. Autre conséquence : les promoteurs de l’IA accaparent les stocks de composants informatiques, notamment la mémoire vive (RAM), ce qui mène à une inflation jamais vue et dessine des hausses de prix sensibles pour tous les produits tech dans les prochains mois.