Une étude rapportée par le journal britannique The Guardian dresse un constat amer de l’état de la plus grande plateforme de partage de vidéos au monde.

Le logiciel de montage vidéo Kapwing a mené son enquête, et les résultats font froid dans le dos. Plus de 20 % des vidéos recommandées par l’algorithme YouTube à de nouveaux utilisateurs ou nouvelles utilisatrices sont totalement créées par l’intelligence artificielle. De l’« AI slop », c’est-à-dire du contenu de faible qualité, uniquement destiné à faire du clic… et à amasser de l’argent facile grâce aux revenus publicitaires.

Des contenus pauvres qui cartonnent

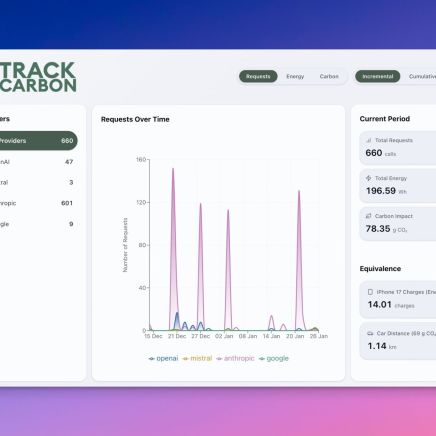

15 000 chaînes YouTube, les plus populaires de chaque pays, ont été analysées par Kapwing, rapportent nos confrères de Next. Parmi elles, 278 ne partagent que du contenu généré par l’IA. Au total, celles-ci ont accumulé plus de 63 milliards de vues de la part de quelque 221 millions d’abonné·es… et ainsi récolté plus de 117 millions de dollars par an de revenus publicitaires.

Comment en est-on arrivé là ? Kapwing montre qu’à partir d’un nouveau compte YouTube, 104 des 500 premières vidéos recommandées (environ 21 %) étaient de l’AI slop. Des contenus faciles à créer, surfant pour la plupart sur la mode du « brainrot », parfaits pour monétiser l’attention des internautes.

D’après le journaliste Max Read, interrogé par le Guardian, c’est en réalité toute une économie parallèle qui s’est rapidement organisée sur YouTube et d’autres plateformes de vidéo. « Il y a une foule de gens sur Telegram, WhatsApp, Discord et les forums qui échangent des conseils, des idées [et] vendent des cours sur la manière de créer du contenu suffisamment attrayant pour gagner de l’argent », explique le spécialiste.

Un laisser-faire de la part de Google

Ce contenu produit à la chaîne en quelques prompts sur Sora ou Veo ne semble en tout cas pas déranger Google outre mesure. Il faut dire que le géant du Web a quelques billes dans l’intelligence artificielle (c’est un euphémisme). Interrogé par le Guardian, un porte-parole de l’entreprise adopte une forme de laisser-faire. « L’IA générative est un outil et, comme tout outil, elle peut être utilisée pour créer du contenu de haute ou de basse qualité. »

L’algorithme de YouTube se moque de savoir si le contenu proposé aux internautes a été généré par l’IA ou pas. Ça fonctionne ? Ça se retrouve dans les recommandations. C’est aussi simple que ça. Le problème étant que, sans régulation, qui sait à combien le chiffre de contenus par IA proposés s’élèvera dans un ou deux ans ? Si l’on prend la musique en exemple, Deezer rapportait qu’en mai 2025, 18 % des mises en ligne quotidiennes étaient des morceaux faits par IA. En septembre dernier, c’était plus de 30 %.

Le risque ? Invisibiliser les créateurs et créatrices qui se donnent du mal pour produire leurs vidéos ; tirer leurs revenus publicitaires vers le bas… et encourager au passage l’utilisation d’outils dont on sait ce qu’ils valent sur le plan éthique (vol de contenu) et écologique. Nous terminerons sur la recommandation fort pertinente de Next, avec cette vidéo sur les dessous du slop, par Arte.