Alors que les échéances ô combien sensibles des élections européennes et de la présidentielle américaine approchent, le réseau social durcit son éventail de protection contre les fake news.

Un nouvel outil bienvenu dans un contexte où l’intelligence artificielle donne l’impression de devenir aussi ubiquitaire qu’incontrôlable sur les réseaux sociaux. Entre détournements de plus en plus réalistes et clonage de contenus visant à générer d’importants revenus, il était grand temps que TikTok prenne le taureau par les cornes.

Une simple balise pour informer

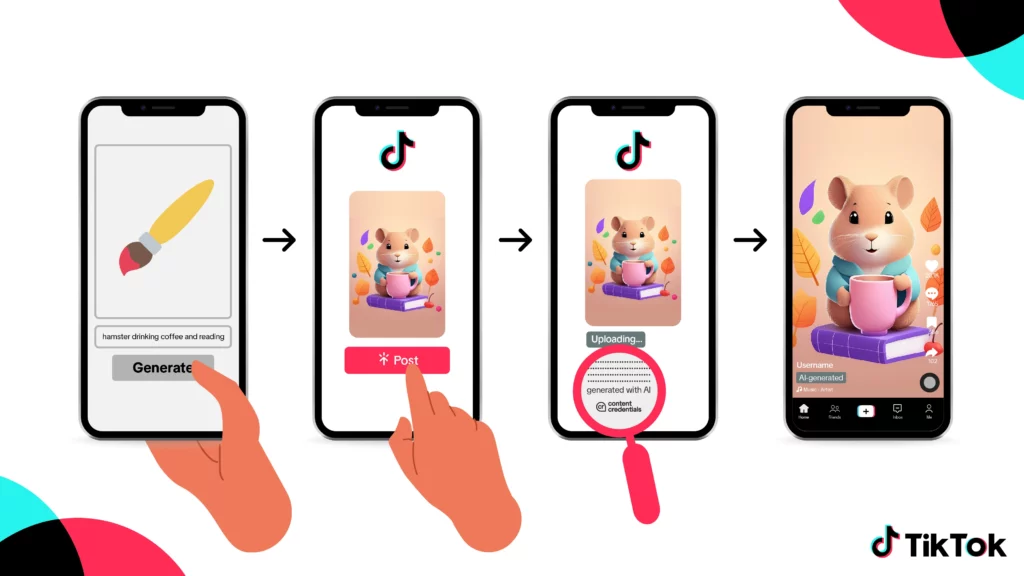

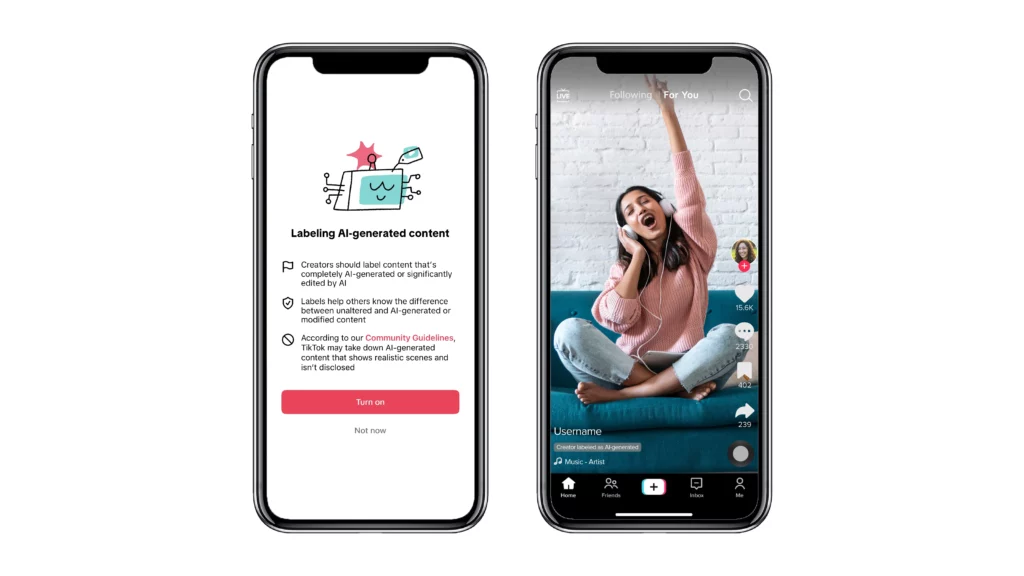

La fonctionnalité est en cours de déploiement sur les versions smartphone et ordinateur du réseau social chinois. Dès qu’un contenu créé ou modifié par intelligence artificielle se présentera à vous, il sera automatiquement labellisé « généré par IA » par l’application.

Ce nouvel outil devrait fonctionner de la même façon que celui permettant de scanner automatiquement les musiques utilisées afin de s’assurer qu’elles ne sont pas protégées par du droit d’auteur. Dès lors qu’un utilisateur téléverse un contenu qui a été créé ou modifié par IA, les algorithmes de TikTok en reconnaissent certains traits et le marquent du sceau « généré par IA ».

« Les intelligences artificielles permettent d’incroyables opportunités créatives, mais peuvent troubler ou induire en erreur les utilisateurs s’ils ne savent pas que le contenu a été généré par l’IA, déclare TikTok dans un communiqué de presse. L’étiquetage aide à clarifier ce contexte – c’est pourquoi nous étiquetons le AIGC [Artificial Intelligence Generated Content] réalisé avec des effets TikTok AI, et nous demandons aux créateurs d’étiqueter les AIGC réalistes depuis plus d’un an. »

Les effets également concernés

Les contenus en provenance de sources externes ne sont pas les seuls à être dans le viseur de TikTok, qui balaie aussi devant sa porte. Ses propres filtres utilisant de l’intelligence artificielle sont désormais labellisés comme tels. Un label qui n’est pas caché dans une interminable description textuelle, mais qui apparait évidemment de façon visible sur l’image.

Une démarche nécessaire dans un contexte où l’intelligence artificielle se développe et s’invite partout, obligeant les gouvernements et entreprises à établir rapidement des barrières pour éviter qu’elle devienne incontrôlable. Ces derniers mois, Meta, mais aussi Adobe (qui s’est placé très vite sur ce marché naissant avec son IA Firefly), ont dévoilé des systèmes de labellisation similaires sur leurs produits.